A inteligência artificial vem transformando setores inteiros da economia, ampliando produtividade, automatizando tarefas e criando soluções antes inimagináveis. No entanto, a mesma tecnologia que impulsiona inovação também pode ser usada para práticas abusivas e criminosas. Casos recentes envolvendo manipulação de imagens por inteligência artificial reacenderam o debate sobre privacidade, dignidade humana e responsabilidade digital. Ao longo deste artigo, será analisado como o uso indevido da IA representa um desafio urgente, quais impactos sociais surgem desse cenário e por que autoridades, plataformas e usuários precisam agir com mais rapidez.

O avanço das ferramentas de edição automatizada tornou a criação de imagens falsas mais simples, barata e acessível. Antes, alterar fotografias com realismo exigia conhecimento técnico avançado. Hoje, bastam poucos comandos para gerar conteúdos altamente convincentes. Isso mudou completamente a escala do problema. Pessoas comuns, figuras públicas e até menores de idade podem se tornar alvos de montagens ofensivas em questão de minutos.

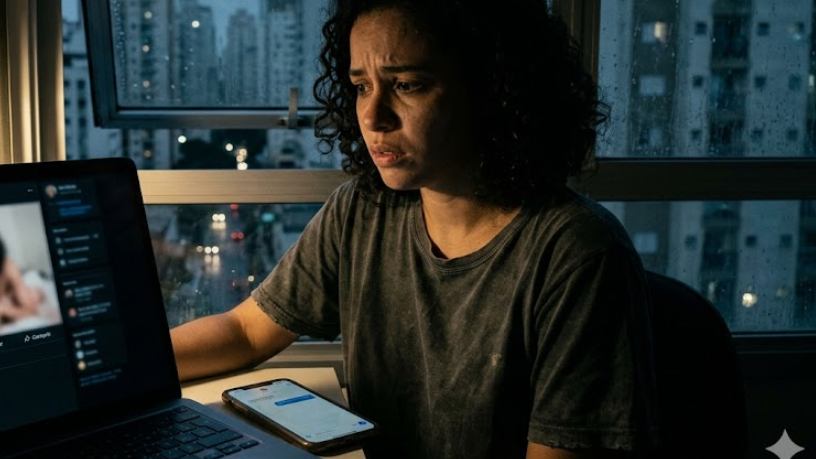

Quando a inteligência artificial é usada para sexualizar imagens sem consentimento, o dano ultrapassa a esfera digital. A vítima sofre constrangimento, abalo emocional, exposição pública e, muitas vezes, medo constante de novos ataques. Em muitos casos, mesmo após a remoção do conteúdo, o impacto psicológico permanece. A internet tem memória longa, e materiais compartilhados ilegalmente podem circular por diversos canais durante anos.

Outro ponto preocupante é a banalização da violência digital. Parte da sociedade ainda trata esse tipo de crime como brincadeira ou simples provocação online. Esse pensamento é perigoso. Manipular imagens para humilhar alguém não é entretenimento. Trata-se de violação de direitos, uso indevido da imagem e potencial prática criminosa. Quanto mais tolerância social existe, maior o espaço para reincidência.

A inteligência artificial também criou um novo desafio para investigações policiais. Muitas ferramentas utilizadas por criminosos funcionam em ambientes anônimos, hospedagens internacionais ou aplicativos de difícil rastreamento. Isso exige das autoridades investimentos constantes em tecnologia, capacitação técnica e cooperação entre estados e países. Sem atualização institucional, o combate a crimes digitais tende a ficar sempre um passo atrás.

Além da atuação policial, as plataformas digitais têm papel central nesse enfrentamento. Redes sociais, aplicativos de mensagens e sites de compartilhamento precisam fortalecer mecanismos de denúncia, acelerar remoções e identificar padrões suspeitos. Em muitos casos, a lentidão das plataformas amplia o prejuízo das vítimas. Quando uma imagem falsa permanece horas ou dias no ar, o dano se multiplica rapidamente.

Também é necessário discutir educação digital. Grande parte da população utiliza redes sociais diariamente, mas ainda sem preparo para reconhecer manipulações tecnológicas ou compreender limites éticos no ambiente virtual. Escolas, famílias e empresas podem contribuir para formar cidadãos mais conscientes. Saber usar tecnologia não significa apenas dominar ferramentas, mas entender consequências jurídicas e humanas de cada ação.

No campo jurídico, o Brasil já possui instrumentos legais relacionados à honra, imagem, privacidade e crimes virtuais. Ainda assim, o avanço acelerado da inteligência artificial exige atualização constante das normas. A legislação precisa acompanhar novas formas de fraude, assédio e exposição indevida. Quando a lei demora a responder, criminosos exploram brechas e aumentam a sensação de impunidade.

Há ainda um aspecto cultural importante. A sociedade costuma celebrar novidades tecnológicas sem refletir sobre seus riscos. Toda inovação poderosa precisa vir acompanhada de responsabilidade proporcional. Isso vale para inteligência artificial, redes sociais e qualquer sistema capaz de influenciar reputações ou causar danos em larga escala. O debate não deve ser contra a tecnologia, mas contra seu uso irresponsável.

Empresas desenvolvedoras também precisam assumir compromisso ético. Ferramentas de IA devem incorporar barreiras de segurança, filtros contra abuso e políticas claras de uso. Modelos liberados sem qualquer controle tendem a ser apropriados por pessoas mal-intencionadas. Inovar sem prever impactos sociais deixou de ser aceitável em um ambiente digital tão sensível.

Para usuários comuns, algumas atitudes ajudam na proteção. Manter perfis privados quando possível, limitar exposição de imagens pessoais, denunciar conteúdos suspeitos e buscar apoio jurídico diante de ataques são medidas relevantes. O silêncio favorece agressores. A denúncia, por outro lado, fortalece investigações e sinaliza que a sociedade não aceita esse comportamento.

A inteligência artificial continuará crescendo e moldando o futuro. Isso é inevitável e, em muitos sentidos, positivo. Porém, o verdadeiro progresso tecnológico não pode ser medido apenas por velocidade ou sofisticação, e sim pela capacidade de melhorar vidas sem destruir reputações e direitos no caminho. O desafio atual é construir um ambiente digital onde inovação e respeito caminhem juntos. Se esse equilíbrio não for prioridade, os prejuízos humanos superarão qualquer benefício técnico.

Autor: Diego Velázquez